Stable Diffusion AI-billedgenerator

Stable Diffusion er en deep learning AI-billedmodel udgivet i 2022 baseret på diffusionsteknikker. Dens udvikling involverede forskere fra CompVis Group og Runway med en beregningsmæssig donation fra Stability og træningsdata fra nonprofitorganisationer. Prøv Stable Diffusion på HIX AI nu!

Hovedtræk ved Stable Diffusion

- Forbedret hurtig overholdelse Generer billeder baseret på detaljerede tekstprompter

- Billede til billede Opret billeder med både tekstprompter og et originalt billede

- Generering af forskelligartet stil Skab billeder i høj kvalitet i alsidige stilarter

- Indmaling Maskér et område for at fjerne eller erstatte et objekt

- Overmaling Udvid det originale billede med sammenhængende tilføjelser af høj kvalitet

- Tekstgengivelse Generer læsbart tekstindhold i billeder

Forbedret hurtig overholdelse

Stable Diffusions tekst-til-billede-funktion forvandler dine tekstopslag til fantastiske billeder i høj kvalitet. Beskriv din vision, og Stable Diffusion genererer detaljerede billeder på få sekunder, fra fotorealistiske scener til fantasifuld kunst.

| Tekstprompt | Outputbillede |

| Et levende cyberpunk-bybillede i skumringen med neonlys, der reflekteres på en regnvåd gade, flyvende biler over hovedet og en ensom skikkelse i en glødende trenchcoat. |  |

| En majestætisk drage svæver gennem en tåget bjergdal, dens skæl glitrer i iriserende farver, omgivet af hvirvlende skyer og gamle ruiner. |  |

| En hyggelig skovhytte under en stjerneklar nattehimmel med glødende ildfluer, en varm veranda oplyst af lanterner og et mystisk nordlys, der danser i baggrunden. |  |

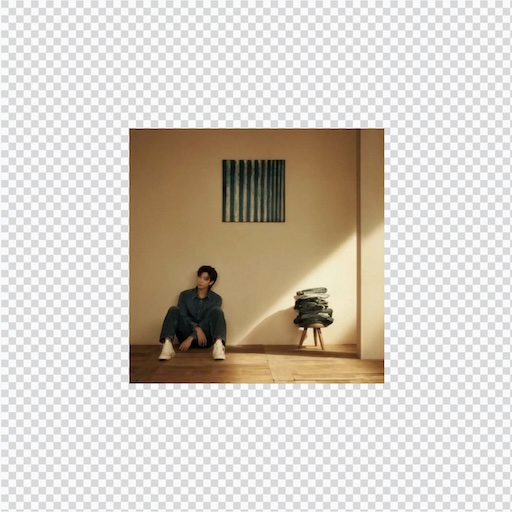

Billede til billede

Dens billede-til-billede-funktion giver dig mulighed for at ændre eksisterende billeder ved hjælp af tekstprompter. Upload et basisbillede, beskriv dine ønskede ændringer, og Stable Diffusion omarbejder det, bevarer kerneelementer og tilføjer nye detaljer eller stilarter.

| Inputbillede | Tekstprompt | Outputbillede |

| en hund, der fanger en frisbee i junglen |  |

Generering af forskelligartet stil

Stable Diffusion understøtter en bred vifte af kunstneriske stilarter, når der genereres billeder, såsom anime, cyberpunk, tegneserier og meget mere.

| Stilarter | Outputbillede |

| Anime |  |

| Cyberpunk |  |

Indmaling

Stable Diffusions inpainting-funktion muliggør præcise billedredigeringer. Maskér et specifikt område, giv en tekstprompt, og Stable Diffusion erstatter eller forfiner det problemfrit og blander det perfekt med originalen for fejlfri, målrettede forbedringer.

| Indgange | Hurtig | Outputbillede |

Billede: Maske:  | en tiger sidder på en parkbænk |  |

Overmaling

Med outpainting-funktionen udvider Stable Diffusion billeder ud over deres oprindelige grænser. Stable Diffusion genererer sammenhængende tilføjelser af høj kvalitet, der er ideelle til at udvide scener eller skabe større kompositioner.

| Indgange | Outputbillede |

|  |

|  |

Tekstgengivelse

Stable Diffusion er i stand til at generere læsbart tekstindhold i billeder, hvilket gør det velegnet til at lave plakater, logoer eller grafik til sociale medier.

| Tekstprompter | Outputbillede |

| Et levende neonskilt, der lyser i et futuristisk bybillede om natten, viser teksten 'Dream Big' med fed, kursiv skrifttype, omgivet af holografiske glimmer og cyberpunk-bygninger. |  |

| Et rustikt træbillboard på en solrig eng med udtrykket 'Adventure Awaits' i stor, blokagtig serif-skrifttype med vilde blomster og en klar blå himmel i baggrunden. |  |

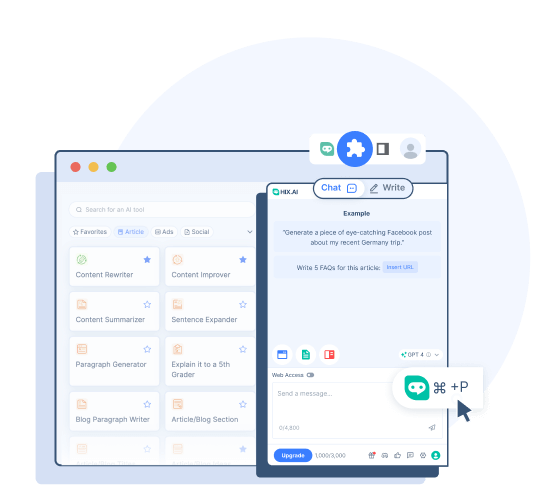

Hvordan bruger man Stable Diffusion på HIX AI?

Indtastningstekstprompt

Indtast tekstprompten, og vælg andre indstillinger.

Opret billede

Klik på Opret, og vent på, at HIX AI genererer dit billede.

YouTube -videoer om Stable Diffusion

Reddit -indlæg om Stable Diffusion

Diskussioner om Stable Diffusion på X

// Stable Diffusion, forklaret //

— AI Pub (@ai__pub) 21. august 2022

Du har set Stable Diffusion AI-kunsten overalt på Twitter.

Men hvordan _fungerer_ Stable Diffusion ?

En tråd der forklarer diffusionsmodeller, repræsentationer af latente rum og kontekstinjektion:

1/15 pic.twitter.com/VX9UVmUaKJ

En undervurderet, tankevækkende kendsgerning om Stable Diffusion og dens finjusterede efterkommere er, at man kan tage en lineær kombination af vægtene fra to modeller (a*w1+(1-a)*w2), og resultatet er, hvad man kunne håbe på - en billedgenerator, der kombinerer funktioner fra begge modeller. pic.twitter.com/vrWZUeGrT5

— Brendan Dolan-Gavitt (@moyix) 15. oktober 2022

Hold da op, billedgenerering og priors for stable diffusion er gode nok til, at du kan prompte den med "cognitohazard", og det laver nogle, der virker. Prøv at se dem i fuld skærm i omkring 30 sekunder og se, hvad der sker pic.twitter.com/R4PJjdFtyz

— vandrende fatamorgana (@atomicthumbs) 6. september 2022

Jeg prøvede Stable Diffusion til Photoshop, det fungerer rigtig godt! pic.twitter.com/KpN4m6a6S5

— Andrei (@Riabovitchev) 17. september 2022

Den nye Stable Diffusion version 2 fra @StabilityAI kommer med en dybde-til-billedmodel, der er i stand til at bevare flere strukturer fra det originale billede 🤯 pic.twitter.com/pjlTLyg9oA

— Radamés Ajna (@radamar) 24. november 2022

Indtast "Lexi", vores fuldstændig kunstige første tegn.

— Sam Emara (@sam_emara) 15. maj 2025

Vi brugte Stable Diffusion 1.5 til at generere billeder.

Udfordringen: at få hende til at se ensartet ud fra forskellige vinkler uden at deepfake rigtige mennesker.

Det var også en udfordring at finde de bedste talenter, så jeg valgte en unik tilgang: pic.twitter.com/lBNkhVabCq

Jeg er forbløffet over, hvor fantastisk Stable Diffusion er til fotorestaurering! #AIArt #StableDiffusion2 / #StableDiffusion pic.twitter.com/JwKejALqY6

— Stable Diffusion 🎨 AI Kunst (@DiffusionPics) 16. marts 2023

Hvorfor har Stable Diffusion problemer med at lave meget mørke eller lyse billeder? Dette problem påvirker faktisk alle diffusionsmodeller - det er umuligt at få et rent sort-hvidt billede til at passe!

— nev (@neverrixx) 12. februar 2023

Der findes en simpel løsning. Dette er en tråd om et blogindlæg fra Cross Labs. (1/7) pic.twitter.com/SH6N7oxeW9

Vægtene af Stable Diffusion, en latent tekst-til-billede diffusionsmodel, er åbne for akademisk forskning efter anmodning!

— Robin Rombach (@robrombach) 10. august 2022

Se https://t.co/zML1NKdQqj for detaljer om, hvordan du får adgang til modellen og modelkortet. pic.twitter.com/ZeIq4hiFLr

"Jeg brugte Stable Diffusion til at lave en baggrund til mit foto, og derefter brugte jeg Photoshop til at lave det endelige billede. Formålet er at bevise, at Stable Diffusion er et værktøj. Et godt et af slagsen. Har også lavet en video: https://t.co/TrL8QPEK8C " #StableDiffusion #AIArt #AIArtwork #DreamStudio pic.twitter.com/3aji0TMPxH

— Stable Diffusion 🎨 AI Kunst (@DiffusionPics) 24. oktober 2022

Ofte stillede spørgsmål

Hvad er Stable Diffusion , og hvordan fungerer det?

Stable Diffusion er en AI-drevet billedgenerator, der skaber billeder i høj kvalitet ud fra tekstprompter eller ændrer eksisterende billeder. Den bruger en latent diffusionsteknologi, der omdanner tilfældig støj til detaljerede visuelle elementer ved iterativt at forfine den baseret på brugerinput, trænet på store datasæt som LAION-5B.

Hvad er de vigtigste træk ved Stable Diffusion?

Stable Diffusion tilbyder tekst-til-billede-generering, billede-til-billede-transformation, inpainting (redigering af specifikke billedområder) og outpainting (udvidelse af billeder ud over deres grænser). Disse funktioner giver brugerne mulighed for at oprette eller ændre billeder med præcis kontrol ved hjælp af tekstprompter.

Er Stable Diffusion gratis at bruge?

Stable Diffusion er open source, hvilket betyder, at selve modellen er gratis at downloade og bruge lokalt. Eller du kan bare prøve den gratis på HIX AI for at generere billeder i høj kvalitet.

Kan Stable Diffusion generere billeder i bestemte kunstneriske stilarter?

Ja, Stable Diffusion kan skabe billeder i forskellige kunstneriske stilarter, såsom akvarel, oliemaleri eller anime, ved at inkludere stilspecifikke termer i din tekstprompt.